Commissiedebat over de inzet van algoritmes en data-ethiek uitgesteld

Vanmiddag zou de Vaste Kamercommissie Digitale Zaken van 13:00 tot 17:00 uur vergaderen over de inzet van algoritmes en data-ethiek binnen de rijksoverheid. Dit is echter tot nader order uitgesteld. Volgens maatschappelijke partners is de overheid nog steeds niet transparant over algoritmes, maar is dat wel mogelijk. Ze hebben de Kamer een vijfsterren-model aangeboden.

Dit debat zou al eerder in september hebben plaatsgevonden, ware het niet dat de Autoriteit Persoonsgegevens (AP) nog niet klaar was met haar advies. Dat verscheen eind oktober. Dit advies kwam in grote lijnen overeen met die van de landsadvocaat, dat in maart werd gepubliceerd. De AP lijkt een meer “nee, tenzij” houding aan te hangen, terwijl de landsadvocaat de lijn “ja, mits” volgt.

De AP vindt dat mensen het recht hebben op een menselijke blik bij besluiten. Dit betekent dat mensen een nieuw, door een persoon genomen besluit kunnen vragen als zij een geautomatiseerd besluit van een organisatie hebben ontvangen.

Lees hierover het artikel van Walter van Holst: Geen paniek over geautomatiseerde selecties – iBestuur

Beleid tot nu toe

- Eind juni 2023 publiceerde werd het Implementatiekader ‘Verantwoorde inzet van algoritmen’ gepubliceerd. Hierin wordt het belang van de uitlegbaarheid en traceerbaarheid van algoritmes benadrukt.

- Het hoofdlijnenakkoord van het huidige kabinet stelt dat er een wetenschappelijke standaard moet komen voor het gebruik van algoritmes, en dat algoritmes ‘openbaar en navolgbaar’ moeten zijn. In het regeerprogramma is opgenomen dat er werk wordt gemaakt ‘van meer transparantie en betere rechtsbescherming bij de inzet van algoritmes.’

- Er is een landelijke Algoritmeregister ontwikkeld waarin alle ministeries hun algoritmes zouden gaan publiceren, dat blijkt echter nog maar voor een zeer klein deel gevuld. Volgens de Rekenkamer is nog maar vijf procent van de algoritmes terug te vinden in het register.

Overheid nog steeds niet transparant

Algoritmische systemen kunnen zo ingewikkeld zijn dat controle en toezicht erop moeilijk is, waarschuwen Open State Foundation, de maatschappelijke coalitie Over Informatie Gesproken en The green land. Ze constateren dat transparantie over algoritmes vaak gezien wordt als een risico in plaats van een kernwaarde, wat het vertrouwen in de overheidsalgoritmes niet ten goede komt. De maatschappelijke organisaties roepen het kabinet op prioriteit te maken van algoritme-transparantie.

‘Als je een algoritme niet kan, wil of mag uitleggen aan inwoners, gebruik ‘m dan niet!’ stelt Serv Wiemers, directeur van Open State Foundation. Hij vindt het Algoritmeregister een stap in de goede richting, maar overheden moeten er ook echt mee aan de slag gaan.

Vijf-sterren-transparantie

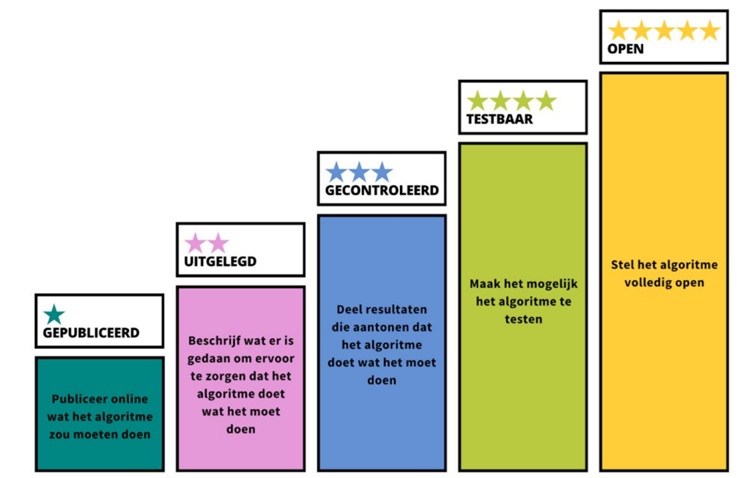

Samen met The Green Land heeft Open State Foundation met andere maatschappelijke partners een model ontwikkeld dat enerzijds bestuursorganen handelingsperspectief biedt richting transparantie en anderzijds de maatschappij (burgers, journalisten, belangengroepen, wetenschappers) de mogelijkheid te controleren en mee te denken. Het vijf-sterren-model biedt een raamwerk voor het stapsgewijs realiseren van transparantie. Met elke ster bied de overheid de burger steeds meer de mogelijkheid om zelf te zien en beoordelen of een algoritme op een verantwoorde manier wordt ingezet.

De afgelopen maanden hebben ze interviews afgenomen met experts binnen en buiten de overheid en een burgerpanel georganiseerd om inwoners inspraak te geven over algoritme-transparantie. Al die verzamelde informatie hebben we opgeschreven in een whitepaper. Hierin staan de belangrijkste conclusies van

het onderzoek en de praktische handvatten om zélf aan de slag te gaan met het model.

Klik HIER voor meer informatie over het model.

Lees ook:

- ‘Overheidsorganisaties weigeren openheid over werking algoritmen’ – iBestuur

- ‘Nog maar 5 procent van alle systemen is in het algoritmeregister terug te vinden’ – iBestuur