Het onderzoek laat zien welke thema’s de samenleving bovenaan de AI-onderzoeksagenda plaatst voor Nederland. Ook geeft het inzicht in de bekendheid van artificiële intelligentie (AI) onder de Nederlandse bevolking. De conclusies en aanbevelingen die voortkomen uit de onderzoeksresultaten scherpen de inhoudelijke koers aan van het programma Societal van de NL AIC.

Nederlanders plaatsen nepnieuws en polarisatie bovenaan AI-onderzoeksagenda

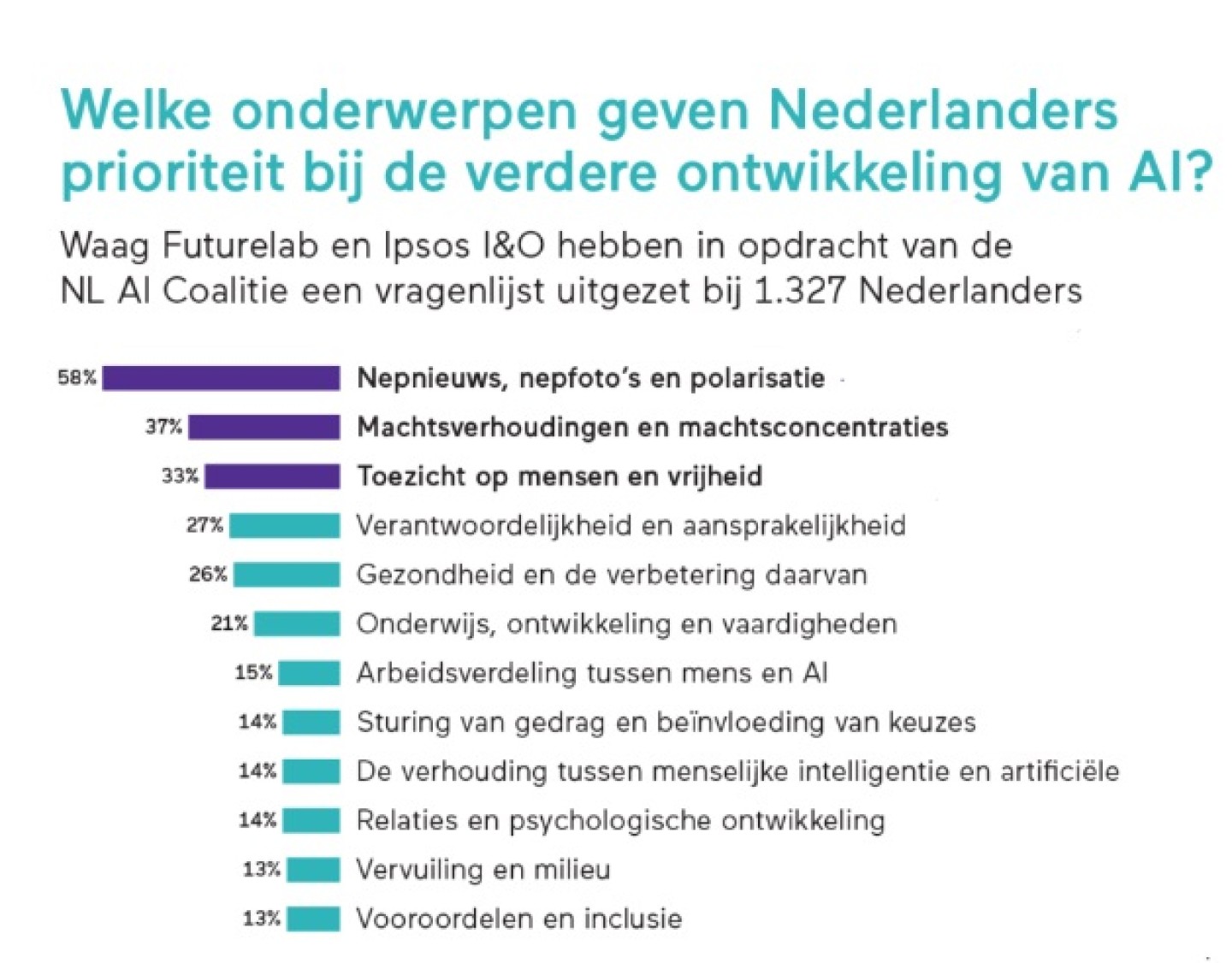

Uit onderzoek in opdracht van de Nederlandse AI Coalitie (NL AIC) blijkt dat Nederlanders zich het meest zorgen maken over nepnieuws en polarisatie. Deze onderwerpen worden het vaakst gekozen uit een lijst met thema’s waar wetenschappers in de toekomst rekening mee zouden moeten houden als ze onderzoek doen naar AI. Het onderzoek werd uitgevoerd door Waag Futurelab in samenwerking met Ipsos I&O.

Belangrijkste resultaten

Anders dan eerder onderzoek liet zien, heeft het overgrote deel van de Nederlandse bevolking een goed tot redelijk beeld bij AIen verbindt er een betekenisvolle associatie aan. Slechts een kleine groep geeft aan geen enkel idee te hebben wat AI is.

Op basis van hun beeld bij AI, maakten respondenten een keuze voor drie belangrijke thema’s die zij op de onderzoeksagenda willen zetten:

- Nepnieuws en polarisatie worden het vaakst gekozen uit een lijst met thema’s waar wetenschappers in de toekomst rekening mee zouden moeten houden als ze onderzoek doen naar AI, met zorgen over verspreiding van valse informatie en deepfake-technologie. Zes op de tien (58%) van de respondenten ziet dit als een cruciaal thema binnen AI.

- Ook maken Nederlanders zich druk over machtsverhoudingen en de controle die AI-experts, wetenschappers, grote en kleine tech-bedrijven en overheden kunnen krijgen. Ruim een derde (37%) acht dit als een belangrijk thema voor verder onderzoek.

- Technologie die toezicht houdt op mensen en de vragen rond vrijheid, verantwoordelijkheid en aansprakelijkheid worden eveneens als cruciaal gezien. Eén op drie (33%) ziet dit als een belangrijk thema.

Aanbevelingen

De uitkomsten van dit onderzoek vragen om een passend antwoord, stelt de Nederlandse AI Coalitie, en doet doet drie aanbevelingen.

- Richt onderzoek en innovatie rond AI op onderwerpen die de samenleving aangeeft; om te beginnen moet er concrete actie worden ondernomen om nepnieuws en nepbeelden tegen te gaan. Dat zou kunnen door te investeren in strategische projecten én open calls waarbij ook partijen uit de samenleving zelf kunnen deelnemen.

- Kantel de machtsverhoudingen door projecten en calls te ontwikkelen die een maatschappelijk doel dienen en waarbij de samenleving de opdrachtgever is. Niet alleen de overheid, wetenschap of bedrijven mogen bepalen wat voor AI we ontwikkelen, maar ook de samenleving.

- Stel kaders op met de samenleving die aangeven waaraan AI moet voldoen. Werk daarin uit wat uitlegbaarheid en transparantie van AI minimaal inhoudt en wat het betekent om publieke waarden te waarborgen in ontwerp zoals vrijheid, democratie, inclusiviteit, privacy en veiligheid.

- Maak substantieel werk van vertrouwen in AI. Geef mensen de kans om invloed uit te oefenen op de ontwikkeling van AI en hun waarden te gebruiken als basis voor ontwerp. Vergroot de kennis van en ervaring met AI in de samenleving met onderwijs en experimenten voor iedereen. En realiseer een organisatie of meldpunt dat AI controleert en waar mensen naartoe kunnen om informatie te krijgen of problemen en/of misstanden te melden.

Lees ook:

Plaats een reactie

U moet ingelogd zijn om een reactie te kunnen plaatsen.