AI Act fase 4

Sinds 1 augustus 2024 is de Europese AI Act van kracht. Deze wet zorgt ervoor dat organisaties AI veilig en verantwoord inzetten, met respect voor de rechten van burgers. Omdat het om een omvangrijke wet gaat, voert de EU deze stap voor stap in. De volgende fase gaat in op 2 augustus 2026: vanaf dan moeten AI-systemen met een hoog risico aan strengere regels voldoen. Voor overheden extra relevant, want veel AI-toepassingen binnen overheidsorganisaties vallen in de categorie hoog risico. Bijvoorbeeld systemen voor uitkeringscontrole, fraudedetectie of geautomatiseerde besluitvorming. In deze blog lees je wat hoog-risico AI is, welke nieuwe verplichtingen komen en hoe je dit concreet aanpakt als organisatie.

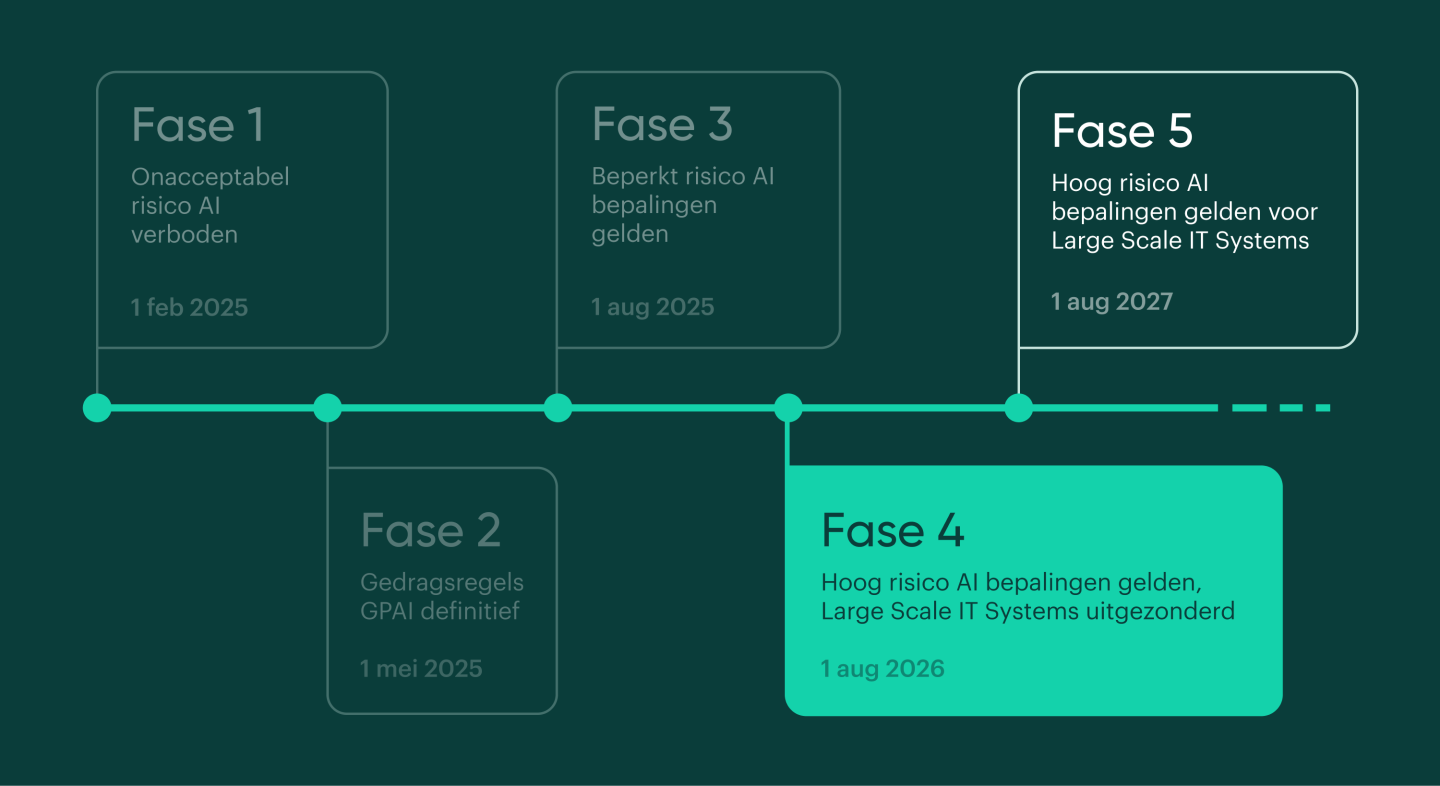

Tijdlijn van alle fases AI Act

De AI Act nadert zijn meest ingrijpende fase. Na het verbod op onacceptabele AI-systemen (fase 1), de gedragscodes voor general purpose AI (fase 2) en de transparantie-eisen voor beperkt risico AI (fase 3), volgt nu fase 4: de verplichtingen voor hoog-risico AI-systemen. Hieronder zetten we overzichtelijk de tijdlijn van begin tot eind:

- Fase 1

Het verbod op AI-systemen met een onacceptabel risico en de verplichting tot AI-geletterdheid: 1 februari 2025. - Fase 2

Het vaststellen van gedragsregels van General Purpose AI (GPAI): 1 mei 2025. - Fase 3

Verplichtingen voor AI-systemen met een beperkt risico: 1 augustus 2025. - Fase 4

De verplichtingen voor AI-systemen met een hoog risico gaan gelden. Grootschalige IT-systemen (Large Scale IT Systems) zijn in deze fase nog uitgezonderd: 1 augustus 2026. - Fase 5

Ook grootschalige IT-systemen moeten voldoen aan de verplichtingen voor hoog-risico AI: 1 augustus 2027.

Wat zijn hoog-risico AI systemen?

Hoog-risico AI zijn systemen die door hun doel of toepassing een groot risico kunnen vormen voor de gezondheid, veiligheid of rechten van mensen. Fouten, vooroordelen of verkeerd gebruik van deze systemen kunnen ernstige gevolgen hebben. Daarom beschouwt de AI Act ze als hoog risico.

Voorbeelden van gebieden waar hoog-risico AI voorkomt, zijn:

- Werk en personeelsbeheer, zoals werving en beoordeling;

- Toegang tot belangrijke publieke of private diensten, zoals het beoordelen van aanvragen voor uitkeringen of vergunningen;

- Veiligheid en handhaving, zoals het gebruiken van AI bij politieonderzoeken of surveillance;

- AI als onderdeel van de veiligheid van producten of systemen, zoals het toepassen van AI in zelfrijdende auto's of medische apparaten.

Het gaat niet om alle AI binnen deze domeinen, maar specifiek om systemen die onder bijlage III van de AI Act [1] als hoog risico zijn aangemerkt.

Voorbeelden binnen de overheid

Voor overheidsorganisaties is vooral de categorie 'essentiële diensten' relevant. Denk aan:

- Algoritmes voor uitkeringscontrole of fraudedetectie;

- Systemen die bepalen of iemand in aanmerking komt voor toeslagen of subsidies;

- AI die bepaalt welke aanvragen eerst worden behandeld;

- Geautomatiseerde besluitvorming over vergunningen.

Daarnaast kunnen HR-afdelingen te maken krijgen met hoog-risico AI bij werving en selectie, bijvoorbeeld tools die CV's screenen of sollicitatiegesprekken analyseren.

De nieuwe verplichtingen vanaf 2 augustus 2026

De AI Act stelt eisen aan het hele proces rondom hoog-risico AI: van ontwikkeling en ingebruikname tot doorlopend gebruik. Als gebruiksverantwoordelijke organisatie ben je aan de volgende verplichtingen gebonden.

Risico’s in kaart brengen en beperken

Organisaties moeten de risico's van het AI-systeem identificeren, beoordelen en beperken. Dit moet vanaf de ingebruikname en zolang het AI-systeem wordt ingezet. Zo voorkom je schade aan mensen en hun rechten, en maak je het systeem veiliger.

Betrouwbare en goede data

De data die het systeem gebruikt, moet betrouwbaar, representatief en relevant zijn. Organisaties moeten ervoor zorgen dat de gegevens goed aansluiten bij het doel van het systeem en geen vooroordelen of fouten veroorzaken.

Menselijke controle en ingrijpen

Er moet altijd een mogelijkheid zijn voor mensen om te controleren wat het systeem doet. Medewerkers moeten kunnen ingrijpen als dat nodig is. Zo voorkom je volledig automatische beslissingen zonder menselijke controle.

Uitleg over het systeem

Gebruikers moeten voldoende informatie krijgen over de werking en beperkingen van het systeem, zodat zij het verantwoord kunnen gebruiken.

Betrouwbare werking en beveiliging van het systeem

Het systeem moet consistent correcte beslissingen maken, beschermd zijn tegen cyberaanvallen en bestand zijn tegen storingen of misbruik.

Beslissingen en systeemgedrag vastleggen

Het systeem moet belangrijke gebeurtenissen en beslissingen vastleggen. Zo kun je later begrijpen wat er is gebeurd en waarom. Dit is essentieel voor transparantie en controle.

Monitoring en melden van risico’s

Je moet het systeem doorlopend monitoren. Wanneer afwijkingen, fouten of risico’s worden vastgesteld, moeten deze tijdig worden doorgegeven aan de juiste personen of organisaties.

Incidentmelding en rapportage

Je moet duidelijk vastleggen wat je als een ernstig incident beschouwt, wie het signaleert en hoe je het rapporteert aan leveranciers en autoriteiten. Dit is nodig om te voldoen aan de meldplicht.

Registratie en FRIA (Fundamental Rights Impact Assessment)

Overheidsorganisaties en organisaties die publieke diensten leveren moeten voor hoog-risico AI een Fundamental Rights Impact Assessment (FRIA) uitvoeren vóór ingebruikname. Dit is een analyse van de impact op grondrechten. De toets brengt in kaart:

- Welke grondrechten het systeem kan raken;

- Welke risico's er zijn voor discriminatie;

- Hoe het systeem de privacy van burgers beïnvloedt;

- Welke maatregelen de risico's beperken.

De FRIA is een aanvulling op de bestaande DPIA (Data Protection Impact Assessment) onder de AVG. Je kunt beide assessments combineren, maar elk kader moet volledig zijn afgedekt. Sommige systemen moet je ook registreren in de EU-database voor gebruik.

Transparantie richting gebruikers en betrokkenen

Als je AI gebruikt voor toepassingen zoals biometrie of interactie met gebruikers (zoals chatbots of emotieherkenning), moet je voldoen aan de regels voor transparantie. Dit betekent dat je gebruikers informeert over wat het systeem doet en welke gegevens het gebruikt, zoals beschreven in Artikel 50 van de AI Act [2].

Wat kun je doen om te voldoen aan de nieuwe verplichtingen?

Inventariseer welke AI-systemen hoog-risico zijn

Maak een overzicht van alle AI-systemen die je gebruikt bij besluitvorming die invloed heeft op inwoners, ondernemers of medewerkers. Bepaal of deze systemen onder ‘hoog-risico AI’ vallen volgens bijlage III van de AI Act [1]. Gebruik hiervoor de Beslishulp AI-verordening.

Bepaal je rol: aanbieder of gebruiksverantwoordelijke

Koop je AI-systemen in? Dan ben je meestal gebruiksverantwoordelijke en is de leverancier de aanbieder. Beide partijen hebben verplichtingen onder de AI Act, maar deze verschillen. Stem af met je leverancier wie waarvoor verantwoordelijk is.

Stel dat je een systeem inkoopt voor fraudedetectie: de leverancier moet technische documentatie leveren, jij moet de FRIA uitvoeren en menselijk toezicht inrichten. Stem daarom af wie de logging verzorgt, hoe lang data bewaard blijft en hoe het systeem menselijk ingrijpen mogelijk maakt.

Regel menselijk toezicht op AI-beslissingen

Zorg dat medewerkers de uitkomsten van AI-systemen kunnen beoordelen en indien nodig kunnen aanpassen. Leg vast wie verantwoordelijk is voor deze controle en hoe ingrijpen in de praktijk werkt.

Controleer de kwaliteit van de data

Zorg dat de gegevens die het systeem gebruikt relevant, representatief en van goede kwaliteit zijn. Zijn de gegevens actueel? Ontbreken er groepen in de dataset?

Implementeer monitoring en meld afwijkingen

Zet monitoring op die de prestaties van het AI-systeem bijhoudt. Bepaal welke afwijkingen gemeld moeten worden en door wie.

Stel een meldprocedure op voor incidenten

Stel vast wat als een ernstig incident wordt beschouwd, wie het signaleert en hoe het gerapporteerd wordt aan leveranciers en autoriteiten.

Bewaar systeemlogbestanden minimaal zes maanden

Configureer het systeem zo dat alle handelingen automatisch worden vastgelegd in logbestanden. Stel de bewaartermijn in op minimaal 6 maanden en controleer of andere wetgeving langere bewaring vereist.

Registreer hoog-risico systemen in de EU-database

Zorg ervoor dat je systemen die onder de ‘hoog-risico’ categorie vallen, vóór gebruik zijn geregistreerd in de EU-database. Dit geldt ook voor publieke organisaties.

Voer een grondrechtentoets uit (FRIA)

Als jouw toepassing onder de FRIA-plicht valt, voer dan voor gebruik een analyse uit die de impact op grondrechten in kaart brengt.

Hulpmiddelen

De VNG en het ministerie van Binnenlandse Zaken bieden hulpmiddelen voor overheidsorganisaties:

1. AI Governance Framework: Praktische tools voor gemeenten.

2. Beslishulp AI-verordening : Bepaal of en hoe de AI Act op jouw systeem van toepassing is.

3. Algoritemekader : Overzicht van vereisten, maatregelen en instrumenten voor algoritmes en AI.

4. Algoritmeregister : Registreer en publiceer informatie over je algoritmes.

5. FRIA Guide ECNL/DIHR : Uitgebreide gids voor het uitvoeren van een Fundamental Rights Impact Assessment.

6. AI Act wetgeving (EUR-Lex) : Officiële tekst van de Europese AI-verordening.

7. EU-database voor hoog-risico AI : Registratie van hoog-risico AI-systemen (wordt beheerd door de Europese Commissie, artikel 71 AI Act [3]).

Bronvermelding

[1] bijlage III van de AI Act

[2] Artikel 50: 'Transparantieverplichtingen voor aanbieders en gebruiksverantwoordelijken van bepaalde AI-systemen'van de AI Act

[3] Artikel 71 'EU-databank voor in bijlage III vermelde AI-systemen met een hoog risico' van de AI Act

Start nu met je voorbereiding

De deadline van 2 augustus 2026 is dichterbij dan je denkt. Begin vandaag nog met het inventariseren van je AI-systemen en bepaal welke onder de hoog-risico categorie vallen. Hoe eerder je begint, hoe meer tijd je hebt om de benodigde maatregelen te treffen.

Plaats een reactie

U moet ingelogd zijn om een reactie te kunnen plaatsen.

Om het wat praktischer te maken (eigen inbreng dus geen formeel beleid):

AI Beleid Compliance Enquête -

Doel: Deze enquête helpt organisatieonderdelen om te bepalen in hoeverre zij voldoen aan het AI Beleid en de onderliggende wet- en regelgeving.

De resultaten dienen als input voor gerichte verbeteracties.

Instructie: Beantwoord elke vraag zo eerlijk mogelijk. Bij twijfel: kies het antwoord dat het beste de huidige situatie weergeeft. De enquête is verdeeld in 8 secties.

SECTIE A: AI-GELETTERDHEID (Artikel 4, AI-verordening)

A1. Zijn alle medewerkers in uw organisatieonderdeel die werken met AI-systemen geïnformeerd over de basisprincipes van de AI-verordening?

[ ] Ja, alle medewerkers zijn getraind

[ ] Ja, de meeste medewerkers zijn getraind (>75%)

[ ] Gedeeltelijk (<75%)

[ ] Nee, er is nog geen training geweest

[ ] Onbekend

A2. Is er een gestructureerd trainingsprogramma voor AI-geletterdheid beschikbaar voor uw organisatieonderdeel?

[ ] Ja, met periodieke herhaling

[ ] Ja, eenmalig aangeboden

[ ] In ontwikkeling

[ ] Nee

[ ] Onbekend

A3. Kunnen medewerkers de volgende concepten uitleggen? (meerdere antwoorden mogelijk)

[ ] Wat een AI-systeem is volgens de AI-verordening

[ ] Het verschil tussen verboden, hoog-risico en laag-risico AI

[ ] Wat generatieve AI is en welke beperkingen gelden

[ ] Wanneer een DPIA of IAMA nodig is

[ ] Hoe het Algoritmeregister werkt

[ ] Geen van bovenstaande

A4. Hoe wordt de AI-geletterdheid van nieuwe medewerkers geborgd?

[ ] Onderdeel van het onboardingproces

[ ] Via de AI-ambassadeur van het team

[ ] Ad hoc / op verzoek

[ ] Niet geborgd

[ ] Onbekend

SECTIE B: VERBODEN AI-PRAKTIJKEN (Artikel 5, AI-verordening)

B1. Is er binnen uw organisatieonderdeel een inventarisatie gemaakt van alle AI-systemen in gebruik?

[ ] Ja, volledig en actueel

[ ] Ja, maar niet volledig of niet actueel

[ ] In uitvoering

[ ] Nee

[ ] Onbekend

B2. Is gecontroleerd of één of meer van deze AI-systemen onder de categorie "verboden AI" vallen?

[ ] Ja, alle systemen zijn getoetst en geen valt onder verboden categorieën

[ ] Ja, er zijn systemen geïdentificeerd die mogelijk verboden zijn (specificeer hieronder)

[ ] Nee, deze toetsing heeft nog niet plaatsgevonden

[ ] Niet van toepassing (geen AI-systemen in gebruik)

B3. Wordt er binnen uw onderdeel gebruikgemaakt van systemen die:

(beantwoord per sub-vraag met Ja / Nee / Onbekend)

Vraag Ja Nee Onbekend

Gedrag van personen proberen te beïnvloeden via subliminale technieken?

Kwetsbaarheden van specifieke groepen uitbuiten?

Sociale scores toekennen op basis van gedrag?

Voorspellen of individuen strafbare feiten zullen plegen?

Gezichtsherkennningsdatabases opbouwen via scraping?

Emoties herkennen op de werkvloer (niet-medisch)?

Personen categoriseren op basis van gevoelige kenmerken?

Biometrische identificatie op afstand voor handhaving?

SECTIE C: HOOG-RISICO AI-SYSTEMEN (Bijlage III, AI-verordening)

C1. Worden er binnen uw organisatieonderdeel AI-systemen ingezet voor een van de volgende doeleinden? (meerdere antwoorden mogelijk)

[ ] Biometrie

[ ] Kritieke infrastructuur

[ ] Onderwijs of beroepsopleiding

[ ] Werkgelegenheid, personeelsbeheer of toegang tot arbeid

[ ] Essentiële publieke diensten of uitkeringen

[ ] Rechtshandhaving

[ ] Migratie, asiel of grensbeheer

[ ] Rechtspraak of democratische processen

[ ] Veiligheidscomponenten van producten

[ ] Geen van bovenstaande

[ ] Onbekend

C2. Indien ja bij C1: Is er voor elk van deze systemen een classificatie uitgevoerd conform de AI-verordening?

[ ] Ja, voor alle systemen

[ ] Gedeeltelijk

[ ] Nee

[ ] Niet van toepassing

C3. Zijn er voor geïdentificeerde hoog-risico systemen de volgende maatregelen getroffen? (per maatregel: Ja / Nee / Niet van toepassing)

Maatregel Ja Nee N.v.t.

Risicomanagementssysteem opgezet (Art. 9)

Data governance maatregelen getroffen (Art. 10)

Technische documentatie opgesteld (Art. 11)

Logging-capaciteit ingebouwd (Art. 12)

Transparantie-informatie beschikbaar (Art. 13)

Menselijk toezicht ingericht (Art. 14)

Nauwkeurigheid en robuustheid geborgd (Art. 15)

Registratie in EU-database (Art. 49)

SECTIE D: GENERATIEVE AI EN TRANSPARANTIE

D1. Wordt er binnen uw organisatieonderdeel gebruikgemaakt van generatieve AI-systemen?

[ ] Ja, gecontracteerd en goedgekeurd

[ ] Ja, maar (deels) niet-gecontracteerd

[ ] Nee

[ ] Onbekend

D2. Indien ja: welke generatieve AI-systemen worden gebruikt? (meerdere antwoorden mogelijk)

[ ] Microsoft Copilot (via Rijkslicentie)

[ ] Azure OpenAI Service (via Rijkscontract)

[ ] Andere gecontracteerde oplossing (specificeer: _____________)

[ ] ChatGPT (publiek account)

[ ] Google Gemini (publiek account)

[ ] Claude (publiek account)

[ ] Open-source modellen (specificeer: _____________)

[ ] Andere (specificeer: _____________)

D3. Worden de volgende transparantievereisten nageleefd bij gebruik van generatieve AI?

Vereiste Altijd Meestal Soms Nooit N.v.t.

AI-gegenereerde content wordt als zodanig gelabeld

Ontvangers weten dat ze met AI-content te maken hebben

Bij chatbot-interacties wordt vermeld dat het AI betreft

AI-gegenereerde tekst voor publiek belang wordt gemarkeerd

D4. Is het gebruik van niet-gecontracteerde generatieve AI (bijv. publiek ChatGPT-account) expliciet verboden en gecommuniceerd?

[ ] Ja, formeel verboden en actief gecommuniceerd

[ ] Ja, formeel verboden maar niet actief gecommuniceerd

[ ] Nee, er is geen formeel verbod

[ ] Onbekend

SECTIE E: RISICOANALYSE EN IMPACT ASSESSMENTS

E1. Wordt er voor elke nieuwe AI-toepassing een risicoanalyse uitgevoerd voordat deze in gebruik wordt genomen?

[ ] Ja, altijd (gestandaardiseerd proces)

[ ] Meestal, maar niet altijd

[ ] Soms

[ ] Nee

[ ] Onbekend

E2. Welke assessments worden uitgevoerd? (meerdere antwoorden mogelijk)

Assessment Standaard Op indicatie Nooit Onbekend

Pre-scan / quick scan

DPIA (Data Protection Impact Assessment)

IAMA (Impact Assessment Mensenrechten en Algoritmes)

FRIA (Fundamental Rights Impact Assessment, Art. 27 AI Act)

BIA (Business Impact Assessment)

E3. Worden risicoanalyses periodiek herhaald voor AI-systemen die al in gebruik zijn?

[ ] Ja, op vaste intervallen (specificeer: ____________)

[ ] Ja, bij significante wijzigingen

[ ] Nee

[ ] Onbekend

E4. Is de Privacy Officer betrokken bij de risicoanalyse van AI-toepassingen?

[ ] Ja, altijd

[ ] Ja, bij toepassingen met persoonsgegevens

[ ] Soms

[ ] Nee

[ ] Onbekend

SECTIE F: REGISTRATIE EN DOCUMENTATIE

F1. Zijn alle AI-systemen en algoritmes binnen uw organisatieonderdeel geregistreerd in de Algoritme Management Toolkit (AMT)?

[ ] Ja, alle systemen zijn geregistreerd

[ ] Gedeeltelijk (schat het percentage: ___%)

[ ] Nee

[ ] Niet bekend met de AMT

F2. In welke levenscyclusfase worden AI-toepassingen geregistreerd?

[ ] Vanaf de probleemanalyse (eerste fase)

[ ] Bij start van ontwikkeling

[ ] Bij implementatie/ingebruikname

[ ] Na ingebruikname

[ ] Niet structureel

F3. Zijn impactvolle algoritmes gepubliceerd in het Algoritmeregister (algoritmes.overheid.nl)?

[ ] Ja, alle impactvolle algoritmes

[ ] Gedeeltelijk

[ ] Nee

[ ] Niet van toepassing (geen impactvolle algoritmes)

[ ] Onbekend

F4. Wordt per AI-systeem vastgelegd wie de beheerder is?

[ ] Ja, voor alle systemen

[ ] Gedeeltelijk

[ ] Nee

[ ] Onbekend

SECTIE G: GOVERNANCE EN ORGANISATIE

G1. Is er een AI-ambassadeur aangewezen voor uw organisatieonderdeel?

[ ] Ja, actief en beschikbaar

[ ] Ja, maar niet actief

[ ] Nee

[ ] Onbekend

G2. Is de Lead AI-ambassadeur voor uw directie/onderdeel bekend en bereikbaar?

[ ] Ja

[ ] Nee

[ ] Onbekend

G3. Worden nieuwe AI-initiatieven meegenomen in het portfolioboard?

[ ] Ja, structureel

[ ] Soms

[ ] Nee

[ ] Niet bekend met het portfolioproces

G4. Zijn de volgende rollen duidelijk belegd voor AI-toepassingen binnen uw onderdeel?

Rol Belegd Niet belegd Onbekend

Behoeftesteller

(Toepassings-)eigenaar

Ontwikkelaar

Beheerder

Dataverantwoordelijke

Data steward

Gebruiker

G5. Is er een exit-strategie beschikbaar voor AI-systemen in gebruik?

[ ] Ja, voor alle AI-systemen

[ ] Ja, voor sommige AI-systemen

[ ] Nee

[ ] Onbekend

SECTIE H: INKOOP EN LEVERANCIERSBEHEER

H1. Worden bij de inkoop van AI-systemen de ARBIT-2022 voorwaarden gehanteerd?

[ ] Ja, altijd

[ ] Meestal

[ ] Soms

[ ] Nee

[ ] Niet van toepassing (geen AI ingekocht)

H2. Zijn er bij gecontracteerde AI-systemen specifieke afspraken gemaakt over:

Onderwerp Ja Nee Onbekend N.v.t.

Eigendom van (trainings)data

Beveiliging en versleuteling

Verwerkersovereenkomst (AVG Art. 28)

Locatie van dataverwerking (EU/EER)

Auditrecht

Exit/transitie-clausule

Incidentmelding en -afhandeling

H3. Wordt bij inkoop voorkeur gegeven aan Europese/Nederlandse AI-oplossingen of open-source modellen?

[ ] Ja, dit is actief beleid

[ ] Wordt meegewogen maar is niet doorslaggevend

[ ] Nee

[ ] Onbekend

SECTIE I: ZELFEVALUATIE VOLWASSENHEIDSNIVEAU

I1. Hoe beoordeelt u het huidige volwassenheidsniveau van uw organisatieonderdeel op het gebied van AI? (schaal 1-5)

Dimensie 1 (Ad hoc) 2 (Herhaalbaar) 3 (Gedefinieerd) 4 (Beheerst) 5 (Geoptimaliseerd)

AI-geletterdheid

Data governance

Risicomanagement

Governance & rollen

Technische infrastructuur

Ethiek & transparantie

Inkoop & leveranciersbeheer

I2. Wat zijn de drie belangrijkste verbeterpunten voor uw organisatieonderdeel?

I3. Welke ondersteuning heeft u nodig van het AI-team BZK/VRO? (meerdere antwoorden mogelijk)

[ ] Training en bewustwording

[ ] Hulp bij risicoanalyses (DPIA/IAMA)

[ ] Technische ondersteuning bij AI-projecten

[ ] Hulp bij registratie in AMT/Algoritmeregister

[ ] Advies over inkoop van AI-systemen

[ ] Ondersteuning bij use case identificatie

[ ] Juridisch advies over AI-verordening

[ ] Anders: _______________________________________________

SCORINGSMODEL

Na invulling kan per sectie een compliance-score worden berekend:

Sectie Onderwerp Weging Max score

A AI-geletterdheid 15% 100

B Verboden AI-praktijken 20% 100

C Hoog-risico AI-systemen 15% 100

D Generatieve AI & transparantie 10% 100

E Risicoanalyse & assessments 15% 100

F Registratie & documentatie 10% 100

G Governance & organisatie 10% 100

H Inkoop & leveranciersbeheer 5% 100

Interpretatie gewogen totaalscore:

90-100: Uitstekend – voldoet aan alle vereisten

70-89: Goed – kleine verbeterpunten

50-69: Voldoende – significante verbeterpunten vereist

30-49: Onvoldoende – urgente actie nodig

0-29: Kritiek – onmiddellijke interventie vereist

De AI-verordening geeft een lijst van categorieën die dan vallen onder hoog-risico.

(Bijlage III van de AI-verordening), maar belangrijk hierbij is Artikel 6, lid 3 (uitzonderingen), dat stelt dat een AI-systeem niet als hoog-risico wordt beschouwd als het:

a) een beperkte procedurele taak verricht;

b) bedoeld is om het resultaat van een eerder voltooide menselijke activiteit te verbeteren;

c) bedoeld is om besluitvormingspatronen of afwijkingen van eerdere besluitvormingspatronen op te sporen, zonder de menselijke beoordeling te vervangen of te beïnvloeden;

d) bedoeld is om een voorbereidende taak uit te voeren.

Als men zich hier goed van bewust is, praat je niet zozeer over verbod en beperkingen, maar kun je AI juist wel degelijk slim en concreet inzetten. Zo kan namelijk alleen al genuanceerder gekeken worden naar RPA (Robotic Process Automation), waar juristen nu nog wel eens over kunnen struikelen. Traditionele RPA is géén machine learning (ML) en valt dus vaak zelfs niet eens onder de definitie van een AI-systeem volgens de AI-verordening. RPA voert regel gebaseerde, deterministische taken uit.

Alleen wanneer RPA wordt gecombineerd met ML-componenten (zogenaamde "Intelligent Automation" of "Hyperautomation") kan het als AI-systeem kwalificeren.

De definitie van een AI-systeem in Artikel 3, lid 1 vereist dat het systeem "met een zekere mate van autonomie werkt" en "voor expliciete of impliciete doelstellingen uit invoer afleidt hoe output moet worden gegenereerd."

Bron: Artikel 3, lid 1 en Artikel 6, leden 2-3, Verordening (EU) 2024/1689; Bijlage III